Comprendre le risque de discrimination des intelligences artificielles : l’IA reproduit les biais de nos sociétés. Découvrez comment les biais algorithmiques affectent le recrutement, la justice et la santé.

L’IA ne discrimine pas par malveillance. Elle discrimine parce qu’on lui a appris à le faire, avec nos données, nos choix, nos angles morts. C’est là le vrai problème : pas une machine qui « pense mal », mais des systèmes qui absorbent les inégalités existantes et les amplifient à une échelle qu’aucun humain ne pourrait atteindre seul.

Concrètement, ça veut dire que ton CV peut être écarté avant qu’un recruteur humain ne le lise. Qu’un algorithme peut peser sur ta peine de prison. Qu’un diagnostic médical peut être moins précis selon ta couleur de peau. Ce ne sont pas des scénarios de science-fiction : ce sont des biais algorithmiques documentés, qui produisent des effets réels sur des vies réelles.

Comme on l’a vu dans notre article sur les enjeux éthiques et les risques liés à l’IA, l’IA n’est pas sans danger. Ce que je veux faire ici, c’est aller plus loin : expliquer les mécanismes, montrer des cas concrets, et identifier ce qu’on peut vraiment faire à son niveau, selon son rôle.

Ce que l’IA fait vraiment, et pourquoi la neutralité est un mythe

L’IA est partout dans les décisions qui nous concernent : embauche, crédit, santé, justice. Et pourtant, on continue de lui prêter une objectivité qu’elle n’a pas. C’est comme confier une décision à quelqu’un en lui disant « sois neutre », alors que cette personne a grandi dans un environnement bourré de préjugés et qu’elle a appris à penser à partir de ça.

L’IA, un outil puissant construit par des humains

Un système d’IA, dans sa version la plus simple, c’est un programme qui apprend à partir d’exemples. On lui montre des milliers, des millions de données, et il identifie des patterns pour prendre des décisions ou faire des prédictions. C’est ce qu’on appelle l’apprentissage automatique : le cœur de la plupart des systèmes d’IA actuels.

Le problème, c’est que ces données viennent du monde réel. Un monde réel où les inégalités existent depuis des décennies, parfois des siècles. Si tu entraînes un algorithme de recrutement sur l’historique d’embauche d’une entreprise qui a surtout recruté des hommes blancs pendant 30 ans, il va apprendre que les hommes blancs sont de bons candidats. Pas parce qu’il est raciste ou sexiste, mais parce que c’est ce que les données lui ont montré.

Ce qu’il faut retenir : la promesse d’objectivité de l’IA est un levier de légitimation dangereux. Quand un humain prend une décision biaisée, on peut la contester. Quand un algorithme le fait, la boîte noire devient un argument d’autorité.

Les biais : d’où viennent-ils vraiment ?

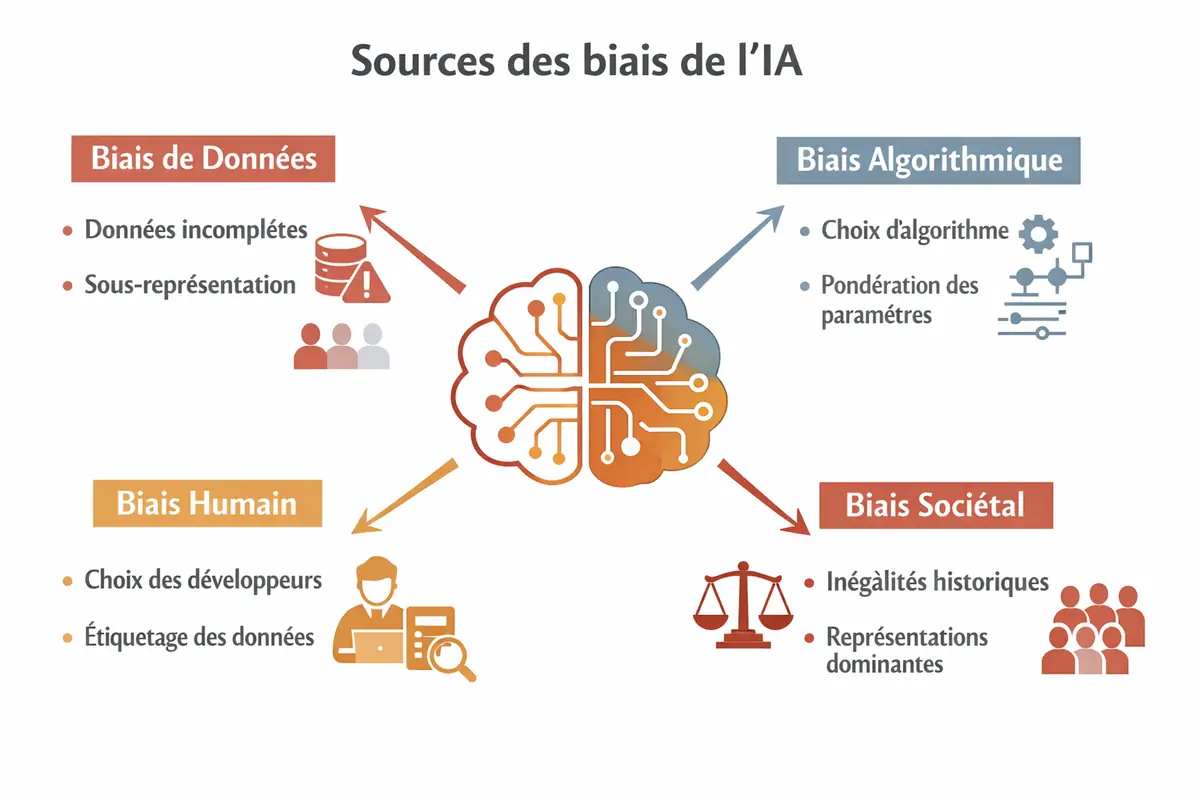

Un biais algorithmique, c’est un écart systématique dans les résultats produits par un système d’IA, qui défavorise certains groupes de personnes. Il peut venir de plusieurs endroits à la fois.

Les biais de données sont les plus courants : données incomplètes, sous-représentation de certaines populations, étiquetage mal fait. Si les données médicales utilisées pour entraîner un outil de diagnostic proviennent majoritairement de patients blancs masculins, l’outil sera moins performant pour les femmes et les personnes racisées. C’est mécanique.

Les biais algorithmiques viennent des choix techniques eux-mêmes : quel algorithme on utilise, comment on pondère les paramètres, quelle métrique on optimise. Ces choix ne sont jamais anodins, ils reflètent des priorités, souvent implicites.

Les biais humains entrent dans la boucle à chaque étape : les développeurs qui définissent les objectifs, les équipes qui étiquettent les données, les décideurs qui choisissent ce qu’on mesure. Personne n’est neutre, et les angles morts de chacun se retrouvent dans le système.

Enfin, les biais sociétaux sont peut-être les plus difficiles à corriger. Ils sont structurels, inscrits dans les données historiques, dans les inégalités d’accès, dans les représentations dominantes. L’IA ne les crée pas : elle les hérite et les perpétue à grande échelle.

Quand la discrimination devient algorithmique : des cas réels

Le problème avec les inégalités numériques produites par l’IA, c’est qu’elles restent souvent invisibles. Pas de témoin, pas de trace facilement contestable. Juste un score, un refus, une décision « automatique ».

Recrutement : ton CV filtré avant d’être lu

Imagine que ton CV est écarté parce que ton prénom sonne « étranger », ou parce que tu as fait tes études dans une école moins cotée que les autres. Pas par un recruteur humain, par un algorithme qui a appris, sur la base des recrutements passés, quels profils « marchent ». C’est exactement ce qui s’est passé chez Amazon, qui a dû abandonner son outil de tri de CV en 2018 après avoir constaté qu’il pénalisait systématiquement les candidatures féminines.

L’algorithme favorisait les profils similaires aux employés existants, reproduisant les biais de recrutement passés. Au-delà du tri de CV, certains outils d’entretien vidéo prétendent analyser les émotions et la personnalité des candidats, avec des résultats qui varient selon la couleur de peau, l’accent ou la luminosité de la pièce. L’équité algorithmique dans le recrutement est loin d’être acquise.

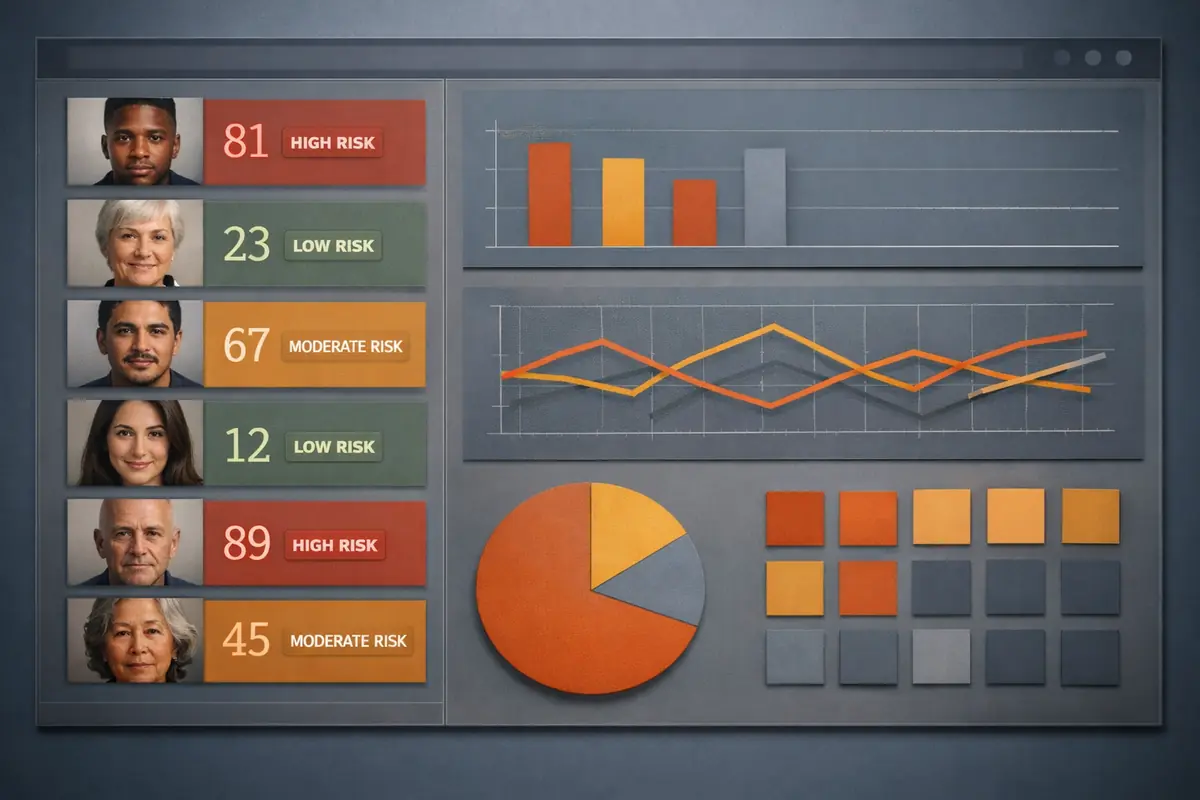

Justice : un algorithme qui prédit la récidive avec des angles morts

Aux États-Unis, l’outil COMPAS est utilisé dans certains tribunaux pour évaluer le risque de récidive d’un prévenu et aider à la décision de mise en liberté conditionnelle. Une étude de ProPublica a montré que cet outil avait un taux d’erreur significativement plus élevé pour les personnes noires : classées à tort comme « à haut risque » deux fois plus souvent que les personnes blanches.

C’est comme si l’algorithme les jugeait coupables avant même qu’elles aient commis un crime. Le problème n’est pas l’outil en lui-même, c’est qu’il a été entraîné sur des données historiques d’arrestation et de condamnation, des données qui reflètent des décennies de prédiction biaisée et de discrimination systémique dans le système judiciaire américain. L’outil amplifie ce qu’il a absorbé.

Santé : des diagnostics moins précis selon qui tu es

Joy Buolamwini, chercheuse au MIT, a documenté quelque chose de glaçant : les logiciels de reconnaissance faciale de grandes entreprises tech reconnaissaient beaucoup moins bien les visages des femmes noires que ceux des hommes blancs. Quand elle portait un masque blanc, la reconnaissance fonctionnait. Sans le masque, le système échouait. Un simple masque blanc et tout change.

Ce n’est pas anecdotique. La sous-représentation de certaines populations dans les données médicales a des conséquences directes sur la qualité des diagnostics. Les femmes sont historiquement sous-représentées dans les études cliniques, et les outils d’IA entraînés sur ces données sont mécaniquement moins précis pour elles. L’impact social de l’IA en santé, c’est des erreurs de diagnostic qui ne font pas les mêmes dégâts selon qui tu es.

Services sociaux : la surveillance algorithmique des plus précaires

Dans plusieurs pays, des algorithmes sont utilisés pour attribuer des aides sociales, détecter des fraudes ou évaluer les besoins des familles. Le problème : ces systèmes sont souvent entraînés sur des données qui reflètent des préjugés préexistants, et les populations les plus précaires sont aussi celles qui ont le moins de recours pour contester une décision automatique.

Si tu veux explorer d’autres dangers potentiels de l’intelligence artificielle, n’hésite pas à lire notre article sur le sujet : la discrimination indirecte produite par ces systèmes y est abordée dans un cadre plus large.

Un exemple historique éclaire bien la mécanique. Dans les années 1970, un hôpital londonien a été condamné pour discrimination raciale après qu’un ordinateur ait appris à discriminer à partir des données fournies par les humains. La technologie était différente, le mécanisme identique. Ce n’est pas nouveau, c’est juste à une échelle inédite aujourd’hui.

Ce qu’on peut faire concrètement à chaque niveau

On n’est pas condamné à subir. L’IA peut être un levier d’exclusion, mais elle peut aussi faire émerger des critères qu’on n’avait jamais regardés avant et révéler des discriminations qu’on ne voyait pas. La condition : décider de regarder.

Auditer les algorithmes avant qu’ils ne causent des dégâts

L’audit algorithmique, c’est l’examen systématique d’un système d’IA pour détecter des biais dans ses résultats. Concrètement, ça veut dire tester si le système produit des résultats différents selon le sexe, l’origine, l’âge ou d’autres caractéristiques protégées, même quand ces variables ne sont pas explicitement utilisées.

| Méthode d’Audit | Description | Avantages | Inconvénients |

|---|---|---|---|

| 📊 Tests Statistiques | Mesure les différences de résultats entre groupes (sexe, origine, etc.). | Simple à mettre en œuvre, quantifie les écarts. | Ne détecte pas les biais indirects. |

| 🔍 Analyse de Sensibilité | Évalue l’impact de variations des données d’entrée sur les résultats. | Identifie les variables les plus influentes. | Coûteuse en calcul, difficile à interpréter. |

| ⚔️ Tests Contradictoires | Modifie un seul attribut (ex: prénom) et observe si la décision change. | Révèle les biais cachés, facile à comprendre. | Nécessite une connaissance fine du système. |

Les outils existent : tests statistiques de disparité, analyse de sensibilité, tests contradictoires (on modifie un seul attribut et on observe si la décision change). Le problème, c’est que l’audit reste souvent volontaire. La transparence algorithmique et l’explicabilité de l’IA ne sont pas encore des standards systématiques, elles devraient l’être.

Des équipes plus diverses, des angles morts moins nombreux

Les équipes qui développent les systèmes d’IA sont encore très homogènes : majoritairement masculines, majoritairement blanches, majoritairement issues des mêmes écoles. Ce n’est pas un jugement moral, c’est un constat qui a des conséquences techniques : les angles morts de l’équipe deviennent les angles morts du système.

Diversifier les équipes en termes de genre, d’origine, de parcours et de discipline, c’est un levier direct contre les biais. Pas parce que la diversité est « bien », mais parce qu’elle produit des systèmes plus robustes. Une équipe qui inclut des personnes concernées par les usages qu’elle développe identifie des problèmes qu’une équipe homogène ne voit tout simplement pas.

Former et sensibiliser : ça commence avant le code

Éduquer les développeurs à l’éthique des données, former les décideurs à lire un audit algorithmique, sensibiliser les utilisateurs à leurs droits : ce sont des leviers concrets. La pensée critique sur les outils qu’on utilise n’est pas réservée aux experts. Elle devrait faire partie de toute formation au numérique.

Ce qu’on observe souvent, c’est que les biais ne viennent pas d’une intention malveillante, ils viennent d’un manque de questionnement. « Ça marche » devient une réponse suffisante, sans se demander « pour qui ça marche, et pour qui ça ne marche pas ».

La réglementation : un filet de sécurité nécessaire, mais pas suffisant

Le RGPD pose des bases importantes : droit à l’explication d’une décision automatisée, interdiction des décisions entièrement automatisées sur des données sensibles. Mais dans les faits, l’application reste inégale et les recours complexes.

L’AI Act européen, entré en vigueur progressivement depuis 2024, va plus loin : il classe les systèmes d’IA par niveau de risque et impose des obligations renforcées pour les usages à haut risque (recrutement, justice, santé, services publics). C’est un progrès réel. Pour en savoir plus sur l’impact du RGPD sur les systèmes d’IA, consulte notre article dédié : les implications pratiques pour les organisations y sont détaillées.

Le problème, c’est que la responsabilité algorithmique reste difficile à établir quand les systèmes sont complexes, opaques et souvent développés par des acteurs hors juridiction européenne. La réglementation est un levier nécessaire, mais elle ne remplace pas la vigilance à chaque étape de la chaîne.

IA et discrimination : poser les bases pour mieux comprendre

Avant d’aller plus loin dans les solutions, il est utile de poser quelques définitions. Pas pour faire théorique, mais parce que les mots qu’on utilise ont des effets réels sur la façon dont on traite le problème.

Ce qu’on appelle intelligence artificielle

L’intelligence artificielle désigne des systèmes capables d’accomplir des tâches qui requièrent normalement des capacités humaines : reconnaître une image, comprendre un texte, prendre une décision. Dans la plupart des usages actuels, ça repose sur l’apprentissage automatique : des algorithmes qui apprennent à partir de données, sans être explicitement programmés pour chaque situation.

Discrimination directe et indirecte : la différence compte

La discrimination directe, c’est traiter quelqu’un moins favorablement en raison d’une caractéristique protégée (sexe, origine, âge, handicap…). La discrimination indirecte, c’est appliquer une règle apparemment neutre qui produit un effet défavorable disproportionné sur un groupe. C’est là que l’IA est particulièrement pernicieuse : elle peut discriminer de manière indirecte, sans jamais utiliser explicitement une variable protégée, en utilisant des proxies (code postal, école fréquentée, type de téléphone) qui corrèlent avec l’origine ou le statut social.

Le lien entre les deux

L’IA ne crée pas la discrimination : elle l’hérite des données et des structures sociales, puis la produit à une échelle et une vitesse inédites. C’est ce qui rend le problème à la fois plus urgent et plus difficile à saisir. Les effets sont diffus, les responsabilités diluées, et les victimes souvent les moins équipées pour contester.

L’IA, c’est un choix, et ce choix nous appartient

L’IA n’est pas une force naturelle qui s’impose à nous. C’est un ensemble de choix techniques, économiques et politiques, faits par des humains, pour des humains. La justice algorithmique ne se décrète pas : elle se construit, à chaque étape, par chaque acteur impliqué.

Les chercheurs qui documentent les biais, les développeurs qui auditent leurs systèmes, les décideurs qui exigent de la transparence, les citoyens qui exercent leurs droits : tous ont un rôle. Ce n’est pas du techno-optimisme naïf : c’est reconnaître que les effets secondaires de l’IA sont réels, et que les corriger demande un effort collectif et délibéré.

La technologie n’a de sens que si elle améliore vraiment la vie des gens. Pas de certains gens. De tous.