Comprendre le RGPD et l’intelligence artificielle : ce guide explique comment concilier ces deux domaines. Découvrez les obligations concrètes, les bases légales, les droits des personnes et les erreurs coûteuses à éviter.

Développer un système d’IA sans cadre RGPD solide, c’est s’exposer. Pas « peut-être ». Pas « dans certains cas ». Systématiquement. Parce que l’IA traite des données personnelles par nature, et le RGPD s’applique dès qu’une donnée personnelle est en jeu, sans exception.

Ce que vous trouverez ici n’est pas un résumé des textes de loi. C’est une méthode : les obligations concrètes, les erreurs qui coûtent cher, les étapes à suivre dans l’ordre, et des cas réels pour illustrer ce qui arrive quand on improvise. Que vous soyez DPO, chef de projet, dirigeant de PME ou responsable d’une collectivité, la question n’est pas « est-ce que le RGPD s’applique à mon IA ? » Elle s’applique. La vraie question est : « suis-je en mesure de le démontrer ? »

RGPD et IA : Pourquoi Ce Duo Engage Votre Responsabilité

L’intelligence artificielle ne fonctionne pas dans le vide. Elle apprend sur des données, prédit à partir de données, décide en s’appuyant sur des données. Et dans la très grande majorité des cas, ces données concernent des personnes physiques identifiables. C’est précisément là que le RGPD entre en jeu, et il entre en jeu pleinement.

Pourquoi le RGPD est incontournable pour tout projet d’IA

Un algorithme de recommandation, un outil de scoring crédit, un système de reconnaissance faciale, un chatbot RH : tous ces outils collectent, analysent ou génèrent des données personnelles. Le traitement automatisé est au cœur du RGPD depuis son entrée en vigueur. L’article 22 du règlement encadre spécifiquement les décisions fondées exclusivement sur un traitement automatisé, y compris le profilage, qui produisent des effets juridiques ou affectent significativement une personne.

Pour les professionnels qui accompagnent la définition de l’intelligence artificielle dans leurs organisations, ce point est non négociable : dès qu’un système d’IA prend ou influence une décision sur une personne, le RGPD s’applique avec toutes ses exigences.

Les risques d’une IA non conforme : amendes, réputation, responsabilité

Les sanctions sont réelles et elles touchent des organisations de toutes tailles. La CNIL peut prononcer des amendes allant jusqu’à 20 millions d’euros ou 4 % du chiffre d’affaires annuel mondial, le montant le plus élevé étant retenu. Mais au-delà de l’amende, c’est la mise en demeure publique, la perte de confiance des clients, et parfois la suspension du traitement qui font le plus de dégâts opérationnels.

Ce que j’observe sur le terrain : la plupart des sanctions ne visent pas des organisations malveillantes. Elles visent des structures qui n’avaient pas de méthode. Pas de registre, pas d’AIPD, pas de base légale documentée. L’absence de rigueur coûte autant que la mauvaise foi.

Les opportunités d’une IA conforme : confiance et différenciation

Ce n’est pas un frein, c’est un cadre. Une IA développée avec les obligations RGPD intégrées dès la conception, ce qu’on appelle le privacy by design, est une IA plus robuste, plus auditable, plus facile à défendre devant vos clients, vos partenaires, vos autorités de tutelle. Dans des secteurs comme la santé, la finance ou les RH, la conformité devient un argument commercial concret. Les appels d’offres publics l’exigent de plus en plus explicitement.

Comment le RGPD S’Applique à Votre Système d’IA : Concrètement

Poser la question « est-ce que mon IA est conforme ? » sans avoir défini la finalité du traitement, la base légale, et les droits applicables, c’est partir sans boussole. Voici les trois piliers à maîtriser.

Les principes clés : finalité, minimisation, transparence

Le RGPD repose sur des principes que tout projet d’IA doit respecter dès la phase de conception :

- Finalité : les données collectées doivent l’être pour un objectif précis, explicite et légitime. Utiliser ensuite ces données pour entraîner un modèle d’IA non prévu initialement est une violation.

- Minimisation : seules les données strictement nécessaires à la finalité doivent être traitées. Un modèle entraîné sur des données superflues expose à un risque réglementaire direct.

- Transparence : les personnes concernées doivent être informées de l’existence du traitement automatisé, de sa logique, et de ses conséquences potentielles.

- Exactitude : des données erronées alimentant un algorithme produisent des décisions erronées et engagent votre responsabilité.

- Limitation de conservation : les données d’entraînement ne peuvent pas être conservées indéfiniment.

Ces principes ne sont pas des recommandations. Ce sont des obligations. Les obligations des entreprises face au RGPD couvrent chacun de ces points et s’appliquent intégralement aux traitements réalisés par des systèmes d’IA.

Les bases légales du traitement : choisir la bonne, pas la plus commode

| Base Légale | Avantages | Contraintes |

|---|---|---|

| Consentement | Donne un contrôle total à la personne. Renforce la confiance. | Doit être libre, éclairé, spécifique et révocable. Peut être difficile à obtenir à grande échelle. |

| Intérêt Légitime | Peut être invoqué sans consentement direct. Utile si l’intérêt de l’organisation est clair et légitime. | Nécessite un test de mise en balance documenté. Risque de contestation par les personnes concernées. |

| Obligation Légale | Assure la conformité avec une loi existante. Simple à justifier si la loi est claire. | Limitée aux cas où une loi impose le traitement. Ne peut pas être utilisée de manière discrétionnaire. |

| Exécution d’un Contrat | Justifie le traitement nécessaire à la fourniture d’un service. Facile à justifier si le traitement est directement lié au contrat. | Limitée aux traitements strictement nécessaires à l’exécution du contrat. Ne couvre pas les traitements indirects. |

Chaque traitement de données personnelles doit reposer sur une base légale identifiée avant le démarrage du projet. Pour les systèmes d’IA, les bases les plus fréquemment invoquées sont :

- Le consentement : valable uniquement s’il est libre, éclairé, spécifique et révocable. Il ne peut pas être présupposé ni obtenu par une case pré-cochée.

- L’intérêt légitime : possible, mais il nécessite un test de mise en balance documenté. Ce n’est pas une base par défaut.

- L’obligation légale : quand un texte impose le traitement, par exemple le contrôle de fraude fiscale par algorithme pour une administration.

- L’exécution d’un contrat : pour les traitements directement liés à la prestation fournie.

Choisir la base légale la plus « pratique » sans analyse préalable est une erreur fréquente et sanctionnable.

Les droits des personnes concernées : ils s’exercent aussi face à une IA

Les personnes dont les données sont traitées par un système d’IA conservent l’intégralité de leurs droits RGPD : accès, rectification, effacement, limitation, opposition, et portabilité. L’article 22 leur accorde en outre le droit de ne pas faire l’objet d’une décision fondée exclusivement sur un traitement automatisé, avec des exceptions strictement encadrées.

En pratique, cela signifie que votre organisation doit être capable de répondre à une demande d’accès en expliquant la logique de l’algorithme, de corriger une donnée erronée dans le modèle, et d’offrir une voie de recours humaine pour toute décision automatisée significative. Si votre système d’IA ne permet pas cela techniquement, c’est un problème de conformité, pas seulement de design.

Les Défis Réels de la Conformité RGPD en Contexte d’IA

Appliquer le RGPD à un système d’IA soulève des difficultés que les textes classiques n’anticipaient pas complètement. Trois points concentrent l’essentiel des difficultés opérationnelles.

Expliquer les décisions d’un algorithme : l’exigence d’explicabilité

Le RGPD impose une transparence sur la logique des traitements automatisés. Mais comment expliquer la décision d’un modèle de deep learning à une personne qui n’a aucune formation technique ? C’est le défi de l’explicabilité (explainability). Il ne s’agit pas de livrer le code source, mais de fournir une information compréhensible sur les facteurs qui ont conduit à une décision.

Des approches comme LIME ou SHAP permettent de produire des explications locales sur les décisions d’un modèle. Les enjeux de l’IA en matière de transparence sont directement liés à cette exigence réglementaire. Ce n’est pas une option technique : c’est une obligation dès lors que des décisions automatisées affectent des personnes.

Lutter contre les biais : une responsabilité juridique, pas seulement éthique

Un algorithme entraîné sur des données historiquement biaisées reproduit et amplifie ces biais. Le RGPD, combiné au règlement européen sur l’IA (AI Act), impose de prévenir les discriminations algorithmiques. Un système de scoring d’embauche qui pénalise systématiquement certains profils démographiques expose son responsable de traitement à des sanctions, y compris au titre du droit anti-discrimination.

Il est obligatoire d’auditer les jeux de données d’entraînement, de tester les modèles sur des sous-groupes représentatifs, et de documenter les mesures prises pour détecter et corriger les biais. Ce n’est pas une démarche de bonne volonté : c’est une responsabilité légale.

Encadrer le profilage : ce que la loi autorise et ce qu’elle interdit

Le profilage (analyser et prédire les comportements d’une personne à partir de ses données) est légal sous conditions. Il doit reposer sur une base légale valide, être transparent, et ne pas conduire à des décisions automatisées sans possibilité de recours humain. Les données sensibles et le RGPD imposent des règles encore plus strictes : un algorithme de profilage qui infère l’état de santé, les opinions politiques ou l’origine ethnique traite des données sensibles, même s’il ne les collecte pas directement, et cela déclenche des obligations renforcées.

Cas concret : Accusation d’IA dans un contexte académique

Un étudiant est accusé par sa faculté d’avoir utilisé l’IA pour rédiger son mémoire, sur la base d’un détecteur automatique. Le détecteur s’avère peu fiable : il produit des faux positifs sur des textes rédigés par des locuteurs non natifs. L’étudiant est sanctionné avant toute vérification humaine. La leçon est directe : une décision automatisée sans contrôle humain, sans transparence sur la logique du système, et sans voie de recours est une violation du RGPD et une faute institutionnelle.

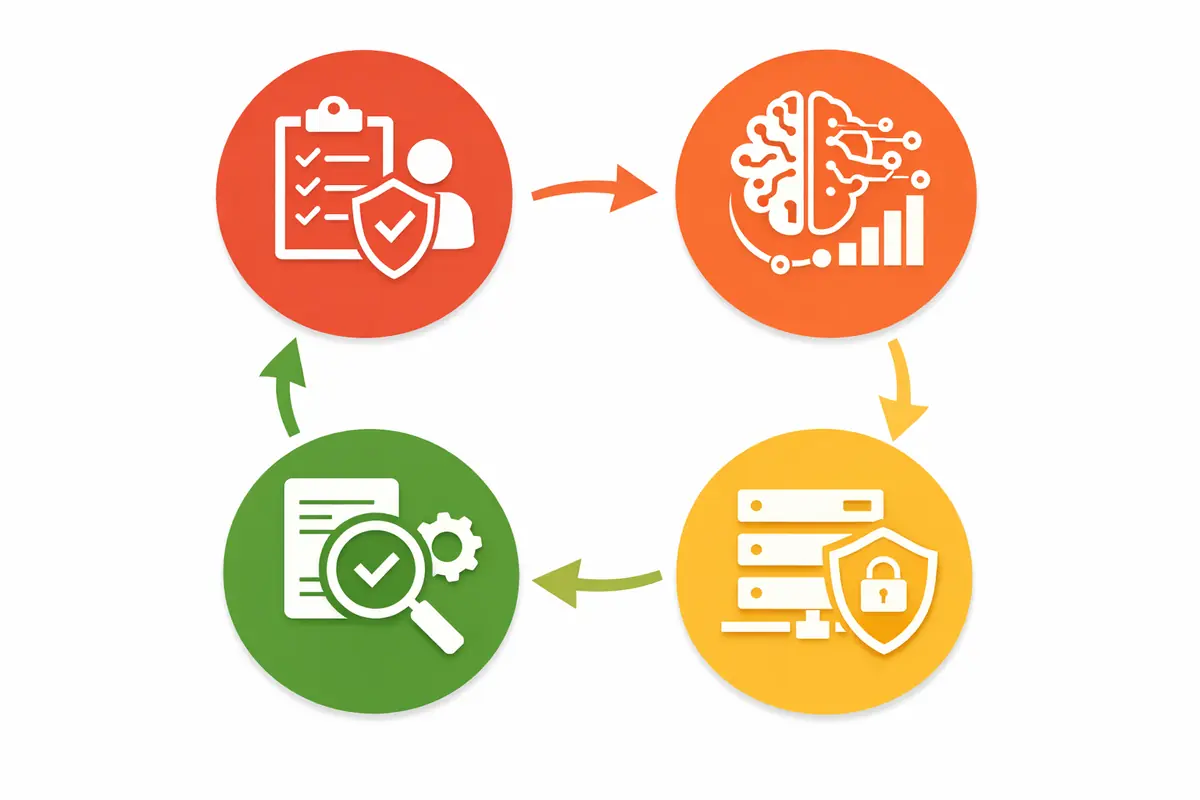

Mettre en Conformité Votre Projet d’IA : Les 5 Étapes dans l’Ordre

La conformité n’est pas un état qu’on atteint une fois. C’est une démarche structurée, documentée, et maintenue dans le temps. Voici la méthode.

Étape 1 : Définir la finalité et la base légale avant tout développement

Avant d’écrire une ligne de code, il est obligatoire de définir : à quoi sert ce système ? Quelles données traite-t-il ? Sur quelle base légale ? Cette définition doit être écrite, précise, et conservée. Elle conditionne toutes les décisions suivantes. Un projet dont la finalité évolue en cours de route doit faire l’objet d’une réévaluation complète.

Étape 2 : Réaliser une AIPD pour les traitements à risque élevé

L’Analyse d’Impact relative à la Protection des Données (AIPD) est obligatoire pour tout traitement susceptible d’engendrer un risque élevé pour les droits et libertés des personnes. Cela couvre la majorité des systèmes d’IA à grande échelle, de profilage, ou traitant des données sensibles. L’AIPD documente les risques identifiés et les mesures prises pour les atténuer. Elle doit être réalisée avant le déploiement, pas après.

Étape 3 : Mettre en place des mesures de sécurité adaptées au risque

Le RGPD impose des mesures de sécurité proportionnées à la sensibilité des données et aux risques identifiés : chiffrement, pseudonymisation, contrôle d’accès, journalisation des accès aux données d’entraînement. Pour les modèles d’IA, il faut également sécuriser les pipelines de données, les environnements d’entraînement, et les interfaces d’inférence. Une violation de données sur un système d’IA doit être notifiée à la CNIL dans les 72 heures.

Étape 4 : Informer les personnes et recueillir le consentement si nécessaire

Si la base légale retenue est le consentement, il doit être recueilli avant le traitement, de manière spécifique et documentée. Si la base légale est différente, l’information des personnes reste obligatoire : elles doivent savoir qu’un système d’IA traite leurs données, dans quel but, et comment exercer leurs droits. Cette information doit être accessible, compréhensible, et disponible avant que le traitement ne commence.

Étape 5 : Documenter et tenir le registre des activités de traitement

Tout traitement réalisé par un système d’IA doit figurer dans le registre des activités de traitement. Ce registre est un document vivant : il évolue avec le projet. Il est obligatoire pour toute organisation de plus de 250 salariés, et recommandé pour toutes les autres dès lors que les traitements présentent un risque. En cas de contrôle CNIL, c’est le premier document demandé.

Des IA Conformes au RGPD : Ce Que Ça Donne en Pratique

La conformité RGPD n’empêche pas l’innovation. Elle la structure. Voici trois secteurs où des applications d’IA respectueuses des obligations de protection des données produisent des résultats concrets.

Santé : des algorithmes encadrés par des obligations renforcées

Les données de santé sont des données sensibles au sens du RGPD. Un algorithme d’aide au diagnostic ou de suivi des patients doit reposer sur le consentement explicite du patient ou sur une base légale spécifique prévue par le droit national. Les établissements de santé qui déploient ces outils doivent réaliser une AIPD systématique, sécuriser les données avec des standards élevés, et garantir qu’un professionnel de santé reste décisionnaire. L’IA assiste, elle ne remplace pas le médecin, ni juridiquement, ni éthiquement.

Justice : l’aide à la décision sous contrôle humain obligatoire

Les outils d’analyse de jurisprudence ou d’aide à la décision judiciaire sont soumis à des contraintes particulières. En France, l’article 22 du RGPD et des dispositions spécifiques du code de justice interdisent que des décisions judiciaires soient fondées exclusivement sur un traitement automatisé. L’IA peut aider à identifier des précédents, à structurer une analyse, mais la décision reste humaine. Ce cadre n’est pas un frein : c’est une garantie pour les justiciables.

Environnement : des traitements moins sensibles, mais pas sans règles

Les systèmes d’IA pour l’optimisation énergétique ou la gestion des déchets traitent souvent des données agrégées ou anonymisées, ce qui réduit les obligations RGPD. Mais dès que des données de consommation individuelle sont impliquées (compteurs intelligents, habitudes de déplacement), les règles s’appliquent pleinement. La minimisation des données est ici particulièrement pertinente : si l’objectif peut être atteint avec des données agrégées, il est recommandé de ne pas collecter de données individuelles.

Cas concret : L’IA en RH, un outil, pas un décideur

Un outil d’IA déployé pour trier des candidatures ou évaluer les performances des collaborateurs traite des données personnelles sensibles dans un contexte à fort impact humain. Ce que j’observe régulièrement : ces outils améliorent la gestion des tâches répétitives (tri de CV, planification, analyse de présence), mais ils ne remplacent pas le jugement du responsable RH. Et juridiquement, ils ne peuvent pas le remplacer : toute décision RH significative doit pouvoir être expliquée et contestée par la personne concernée. L’IA facilite. L’humain décide.

Les Erreurs Qui Coûtent Cher et Comment les Éviter

Ces erreurs ne sont pas théoriques. Je les rencontre régulièrement dans les audits.

Négliger la transparence des algorithmes

Un système d’IA dont la logique de décision est opaque pour les personnes qu’il affecte est non conforme. Il ne suffit pas de mentionner dans une politique de confidentialité qu’un « traitement automatisé peut être utilisé ». Il est obligatoire d’informer sur la logique du traitement, son importance, et ses conséquences prévisibles. Si votre équipe technique n’est pas en mesure de produire cette explication, c’est un problème de conception à corriger avant le déploiement.

Oublier de recueillir le consentement quand il est nécessaire

Le consentement n’est pas toujours la base légale requise, mais quand il l’est, il doit être valide. Un consentement obtenu par une case pré-cochée, noyé dans des CGU, ou conditionné à l’accès au service est invalide. Les sanctions pour consentement non conforme sont régulières et documentées. Il est recommandé de faire valider le mécanisme de recueil du consentement par un DPO avant tout déploiement.

Ignorer les droits des personnes concernées

Une personne dont les données alimentent votre modèle d’IA peut exercer son droit d’accès, de rectification, ou d’effacement. Si votre architecture technique ne permet pas de répondre à ces demandes dans les délais légaux (un mois, extensible à trois mois dans certains cas), vous êtes en infraction. Ce point doit être intégré dès la conception du système, pas ajouté en urgence après une plainte.

Se focaliser sur la conformité formelle

Avoir un registre de traitement, une politique de confidentialité et une mention légale ne signifie pas être conforme. La conformité RGPD est une démarche continue : les traitements évoluent, les modèles sont réentraînés, les finalités peuvent dériver. Il est risqué de considérer la conformité comme un état acquis définitivement. Une revue annuelle des traitements d’IA est une bonne pratique minimale, une obligation pour les traitements à risque élevé.

Cas concret : Une université allemande devant la justice

Une université allemande a engagé des procédures disciplinaires contre des étudiants sur la base de détecteurs d’IA présentés comme fiables. Ces outils ont produit des faux positifs, conduisant à des sanctions injustes. L’affaire a été portée devant les tribunaux. La leçon est double : les détecteurs d’IA ne sont pas des preuves fiables, et une décision disciplinaire fondée exclusivement sur un traitement automatisé sans vérification humaine est juridiquement contestable et humainement inacceptable.

RGPD et IA : Les Fondements à Connaître

Le RGPD : un texte européen aux effets mondiaux

Le Règlement Général sur la Protection des Données (RGPD) est entré en application le 25 mai 2018. Il s’applique à toute organisation (publique ou privée, quelle que soit sa taille) qui traite des données personnelles de résidents européens, même si elle est établie hors de l’Union européenne. Ses principes fondateurs (licéité, loyauté, transparence, minimisation, exactitude, limitation de conservation, intégrité et confidentialité) définissent le cadre dans lequel tout traitement de données doit s’inscrire.

Le RGPD est le cadre légal principal à considérer lorsque l’on parle de l’impact de l’IA sur la protection des données. Il ne s’applique pas seulement aux bases de données clients : il s’applique à tout traitement de données personnelles, y compris les données d’entraînement des modèles d’IA.

L’Intelligence Artificielle : des réalités très différentes sous un même terme

L’IA recouvre des technologies très diverses : apprentissage automatique (machine learning), apprentissage profond (deep learning), traitement du langage naturel, vision par ordinateur, systèmes experts. Ce que ces technologies ont en commun du point de vue du RGPD, c’est qu’elles traitent des données pour produire des résultats, et que ces données sont souvent personnelles. L’IA générative (modèles de type LLM) soulève des questions spécifiques sur les données d’entraînement, la mémorisation d’informations personnelles, et la transparence des outputs.

Ce Qu’il Faut Retenir : Les Points Non Négociables

La conformité RGPD d’un système d’IA repose sur cinq constats que l’expérience de terrain confirme systématiquement.

Les détecteurs d’IA ne sont pas des preuves. Ils produisent des faux positifs, notamment sur des textes rédigés par des non-natifs ou dans des styles formels. Fonder une décision disciplinaire ou juridique sur leur seul résultat est une faute.

L’IA assiste, elle ne décide pas à la place de l’humain. Juridiquement, le responsable de traitement reste responsable des décisions prises avec l’aide d’un système d’IA. Cette responsabilité ne se délègue pas à l’algorithme.

Le RGPD n’est pas un obstacle à l’innovation. C’est un cadre. Les organisations qui l’intègrent dès la conception de leurs systèmes d’IA produisent des outils plus robustes, plus auditables, et plus durables.

La conformité est une démarche, pas un document. Un registre de traitement sans révision annuelle, une AIPD réalisée une seule fois pour un système qui évolue, un consentement recueilli sans mécanisme de retrait : ce sont des conformités de façade. La CNIL les identifie.

La CNIL publie des recommandations spécifiques à l’IA. Ces recommandations (accessibles sur le site de l’autorité) constituent une référence pratique pour les DPO et les équipes de développement. Les ignorer, c’est s’exposer à ne pas pouvoir justifier ses choix en cas de contrôle.

Sans cadre, on s’expose. Avec un cadre rigoureux, l’IA devient un levier, pas un risque.