L’intelligence artificielle (IA) regroupe les techniques permettant à une machine de simuler des fonctions cognitives humaines, comme le raisonnement et la création. Elle s’appuie sur l’apprentissage automatique pour traiter des données, identifier des modèles et exécuter des tâches précises (santé, finance, transport) tout en présentant des limites structurelles telles que les biais algorithmiques.

L’intelligence artificielle n’est pas un cerveau électronique, ni une magie de science-fiction. C’est un ensemble de techniques qui permettent à une machine d’effectuer des tâches pour lesquelles, jusqu’ici, on avait besoin d’un être humain : reconnaître une voix, traduire un texte, détecter une anomalie médicale. Voilà la définition utile, celle qui sert à quelque chose.

Ce qui est moins souvent dit : ces systèmes ont des limites réelles, des angles morts connus, et des effets secondaires qui méritent qu’on s’y arrête. C’est précisément ce que cet article fait — sans promesses creuses, sans jargon inutile.

Pour aller plus loin sur ce que cette technologie change vraiment dans nos vies, l’article sur les enjeux de l’IA offre un panorama complet des implications concrètes.

Ce que l’IA fait, concrètement, dans cinq secteurs clés

Avant toute définition, voici ce que l’IA produit dans des contextes réels — parce que c’est de là que part la compréhension.

En santé, des algorithmes analysent des images médicales (radios, IRM) pour détecter des tumeurs, parfois plus tôt qu’un radiologue humain. Des modèles d’apprentissage automatique accélèrent la recherche pharmaceutique en simulant des interactions moléculaires.

En finance, les systèmes de détection de fraudes croisent des milliers de transactions par seconde pour repérer des comportements anormaux. Le trading algorithmique exécute des ordres en quelques microsecondes en réponse à des signaux de marché.

Dans le transport, les systèmes d’aide à la conduite autonome combinent vision par ordinateur et capteurs pour interpréter l’environnement routier. Les plateformes logistiques utilisent l’IA pour optimiser les itinéraires en temps réel.

En marketing, les moteurs de recommandation — ceux qui vous suggèrent un film, un produit, un article — reposent sur le traitement du langage naturel et l’analyse comportementale. Les chatbots gèrent une part croissante du service client de premier niveau.

Dans l’industrie, la maintenance prédictive analyse les vibrations et températures des machines pour anticiper les pannes avant qu’elles surviennent. L’automatisation robotique prend en charge des tâches répétitives ou dangereuses.

Algorithmes, données, modèles : ce qui se passe vraiment à l’intérieur

Un système d’IA fonctionne selon un principe simple à énoncer, mais exigeant à mettre en œuvre : on lui fournit des données, on lui indique ce qu’on cherche, et il apprend à reconnaître des patterns pour répondre à de nouvelles situations.

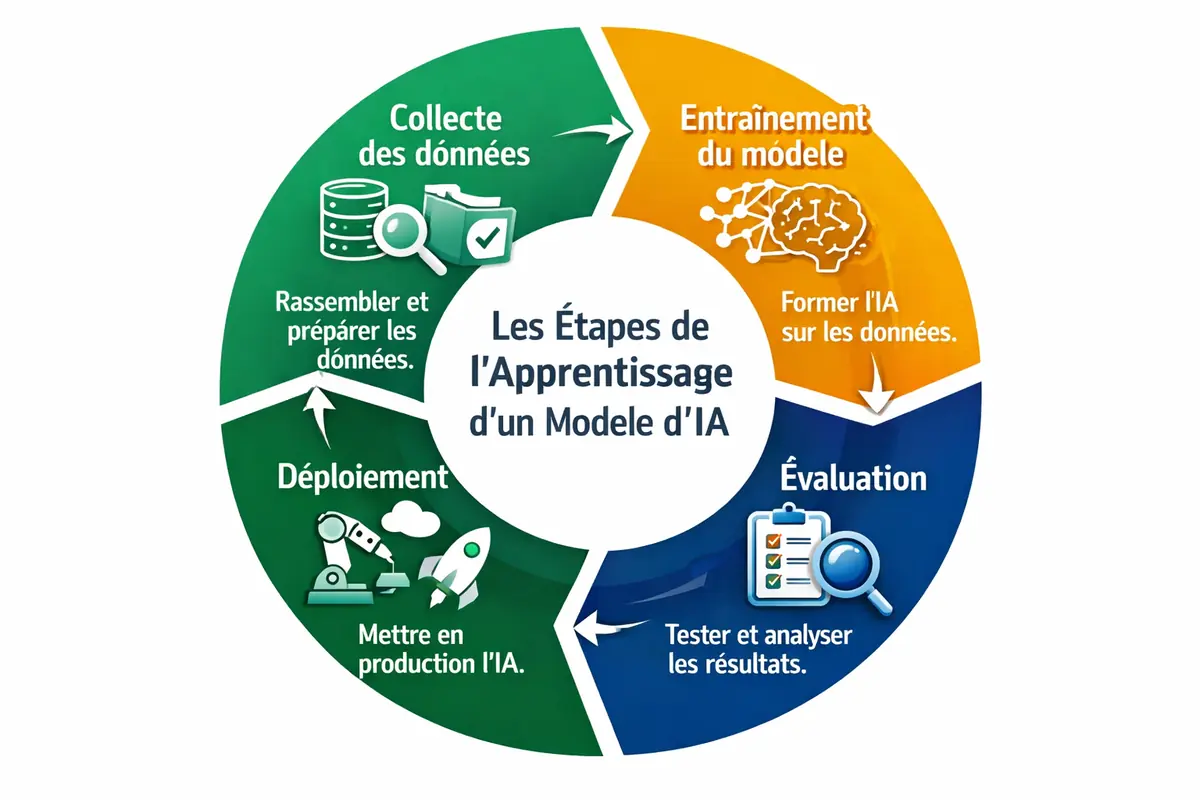

Concrètement, le processus suit quatre étapes. D’abord, la collecte des données : des milliers, parfois des milliards d’exemples annotés (photos, textes, transactions). Ensuite, l’entraînement du modèle : l’algorithme ajuste ses paramètres internes jusqu’à produire des prédictions cohérentes avec les exemples fournis. Puis l’évaluation : on teste le modèle sur des données qu’il n’a jamais vues pour mesurer ses performances réelles. Enfin, le déploiement : le modèle est intégré dans un produit ou un service.

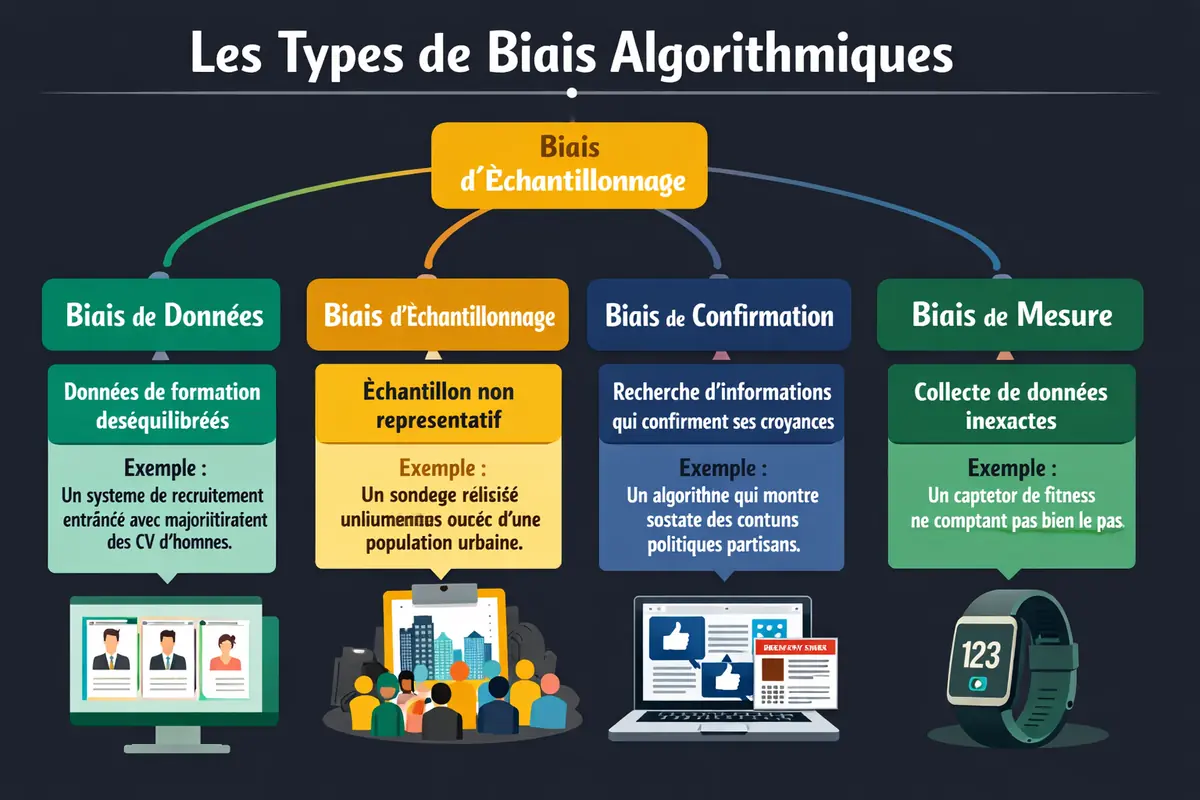

Le point critique, souvent sous-estimé : la qualité des données d’entrée détermine directement la qualité des résultats. Si certains cas réels n’ont pas été pris en compte dans les données d’entraînement, on parle de manque de représentativité — et ce manque génère des biais algorithmiques qui peuvent avoir des conséquences concrètes sur les personnes concernées.

L’infrastructure qui rend tout cela possible repose largement sur le cloud computing, qui fournit la puissance de calcul nécessaire à l’entraînement de modèles complexes sans investissement matériel massif.

Trois types d’IA : ce qui existe, ce qui est théorique, ce qu’on confond

La littérature distingue trois grandes catégories, mais leur statut réel est très inégal.

L’IA faible (ou IA étroite) est la seule qui existe réellement aujourd’hui. Elle est conçue pour une tâche précise et ne peut pas en sortir. Un système expert médical sait analyser des images pulmonaires, mais il est incapable de conduire une voiture ou de comprendre une blague. Tous les assistants virtuels, moteurs de recommandation et outils de vision par ordinateur actuels appartiennent à cette catégorie.

L’IA forte désigne un système capable de raisonner de manière générale, comme un humain, dans n’importe quel contexte. Elle reste un concept théorique. Aucun système existant en 2026 n’en remplit les critères.

L’Intelligence Artificielle Générale (IAG) est une variante de ce concept — une machine qui pourrait non seulement raisonner, mais aussi apprendre de façon autonome dans des domaines entièrement nouveaux. Les chercheurs débattent encore de sa faisabilité réelle, certains la jugent impossible avec les architectures actuelles.

| Type d’IA | Caractéristiques | Exemples |

|---|---|---|

| IA Faible (ou IA étroite) | Conçue pour une tâche précise. Ne peut pas en sortir. | Assistants virtuels, moteurs de recommandation, outils de vision par ordinateur. |

| IA Forte | Capable de raisonner de manière générale, comme un humain, dans n’importe quel contexte. | Concept théorique. Aucun système existant n’en remplit les critères. |

| Intelligence Artificielle Générale (IAG) | Machine capable de raisonner et d’apprendre de façon autonome dans des domaines nouveaux. | Concept théorique. Faisabilité débattue. |

Les limites que personne ne met en avant

C’est ici que le discours habituel sur l’IA s’arrête trop vite. Les limites ne sont pas anecdotiques : elles structurent les risques réels.

Les biais algorithmiques sont la conséquence directe de données mal représentatives. Un modèle entraîné principalement sur des données d’une population donnée reproduira les angles morts de ces données — et parfois les amplifiera. Des systèmes de recrutement automatisés ont ainsi défavorisé des candidatures féminines parce qu’ils avaient été entraînés sur des historiques d’embauche dominés par des hommes. Ce n’est pas un dysfonctionnement : c’est le système qui fonctionne exactement comme il a été construit.

La qualité des données en conditions réelles est un autre facteur critique. La performance d’un assistant vocal diminue significativement dans un environnement bruyant — non pas parce que le modèle est mauvais, mais parce que les données audio qui lui parviennent sont dégradées par rapport à ce qu’il a appris à traiter.

La qualité des composants physiques joue également un rôle souvent ignoré. Un système de détection d’incivilités par IA s’est avéré sujet à davantage d’erreurs lorsque les caméras utilisées avaient une résolution insuffisante. Le modèle était performant ; le matériel limitait sa portée réelle.

Le manque de transparence — ce qu’on appelle la « boîte noire » — est un problème de gouvernance autant que technique. Lorsqu’un réseau de neurones prend une décision, il est souvent impossible d’expliquer précisément pourquoi. C’est un obstacle majeur dans des contextes où la décision doit être justifiable : justice, médecine, crédit.

Les enjeux éthiques touchent à la vie privée, à la surveillance de masse, et à la question de la responsabilité : si un système autonome cause un préjudice, qui en répond ?

Pour un état des lieux complet de ces problèmes, les dangers potentiels de l’IA sont documentés de façon détaillée, avec des cas concrets.

Ce que l’IA pourrait devenir — et les conditions qui manquent encore

Trois tendances structurent les travaux de recherche en 2026.

L’IA explicable (XAI) cherche à rendre les décisions des modèles compréhensibles par des humains non spécialistes. C’est une réponse directe au problème de la boîte noire, portée notamment par des exigences réglementaires croissantes en Europe.

L’IA frugale vise à réduire l’empreinte énergétique et computationnelle des modèles. L’entraînement de grands modèles de langage consomme des ressources considérables — une question qui devient difficilement contournable à mesure que la transition écologique s’impose comme contrainte réelle et non comme option.

L’impact sur le travail reste le sujet le plus controversé. Les analyses divergent : certains emplois sont effectivement menacés par l’automatisation dans des secteurs à tâches répétitives ; d’autres sont transformés plutôt que supprimés ; de nouveaux métiers émergent autour de la supervision, de l’audit et de la formation des modèles. Ce qui est certain : l’adaptation des compétences est une nécessité, pas une option.

Le cadre réglementaire européen — dont l’AI Act — impose des obligations de transparence, de supervision humaine et d’évaluation des risques pour les systèmes à impact élevé. C’est un changement de paradigme : l’IA n’est plus seulement une question technique, c’est une question de droit et de responsabilité.

D’autres technologies numériques évoluent en parallèle et influencent le développement de l’IA, notamment la technologie blockchain, qui ouvre des pistes sur la traçabilité et la vérification des données utilisées pour entraîner les modèles.

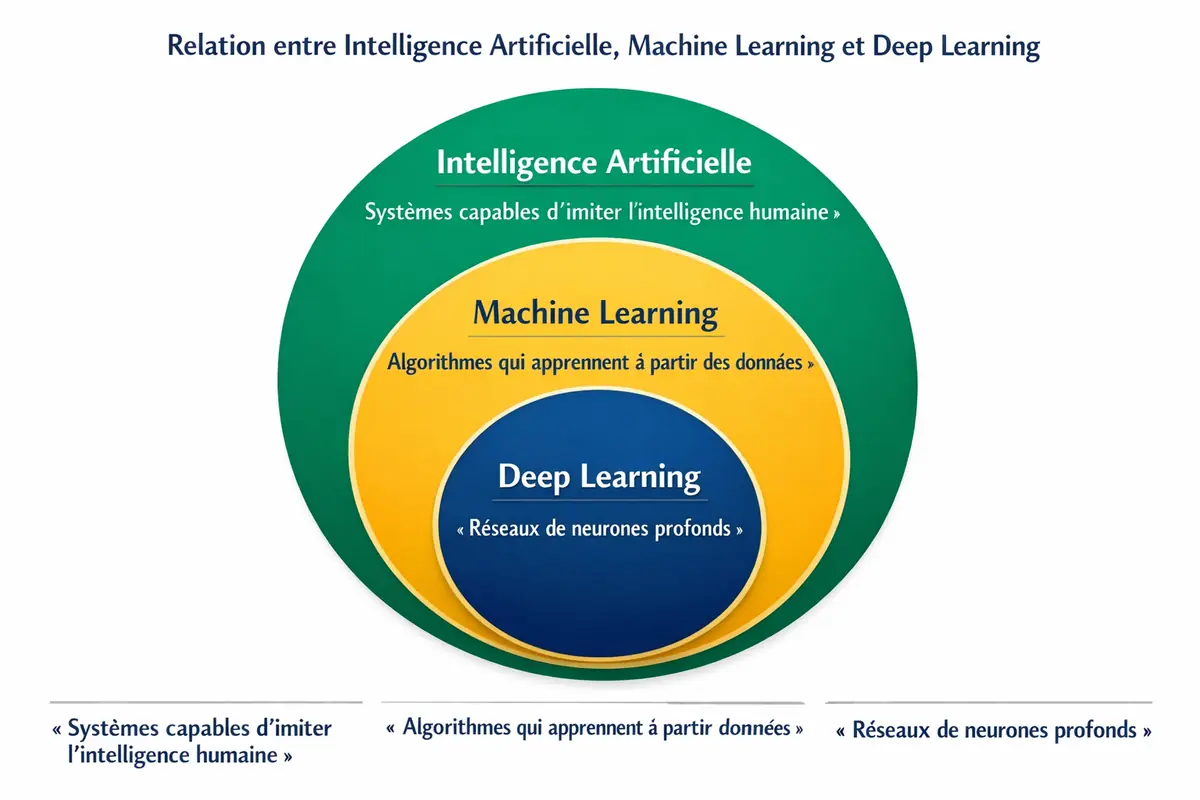

IA, Machine Learning, Deep Learning : trois concepts, un seul schéma à retenir

Ce que recouvrent vraiment ces trois termes

L’intelligence artificielle est le terme générique : il désigne l’ensemble des méthodes permettant à une machine de simuler des capacités cognitives. Le Parlement Européen la définit comme la tentative de « reproduire des comportements liés aux humains, tels que le raisonnement, la planification et la créativité ». La Commission Européenne précise que l’IA regroupe les approches d’apprentissage automatique et les approches fondées sur la logique.

Le Machine Learning (apprentissage automatique) est une sous-catégorie de l’IA. Plutôt que de programmer explicitement des règles, on fournit des exemples au système, qui apprend à généraliser. C’est la base de la majorité des applications IA actuelles.

Le Deep Learning (apprentissage profond) est une sous-catégorie du Machine Learning. Il repose sur des réseaux de neurones à plusieurs couches, capables de traiter des données complexes — images, sons, textes — avec une précision que les méthodes antérieures ne permettaient pas d’atteindre. Ce sont ces architectures qui ont rendu possibles la reconnaissance vocale moderne, la traduction automatique et la génération de texte.

La relation est inclusive : tout Deep Learning est du Machine Learning, tout Machine Learning est de l’IA — mais l’inverse n’est pas vrai.

Ce qu’il faut retenir sans se laisser impressionner

L’intelligence artificielle est une réalité opérationnelle dans de nombreux secteurs — santé, finance, transport, industrie. Elle repose sur des principes clairs : des données, des algorithmes, un entraînement, un déploiement. Ses capacités actuelles sont celles de l’IA faible : performante dans un périmètre défini, fragile dès qu’on en sort.

Ses limites sont connues et documentées : biais liés aux données, sensibilité aux conditions réelles, dépendance à la qualité du matériel, opacité des décisions. Ces limites ne sont pas des bugs en attente de correctif — elles sont structurelles et demandent une vigilance constante.

Ce que cette technologie deviendra dépend moins de l’IA elle-même que des choix humains qui l’entourent : quelles données, quels objectifs, quels garde-fous, quelle responsabilité. C’est là que se jouent les vraies questions.

2 réflexions au sujet de “Intelligence Artificielle : ce que c’est vraiment, comment ça marche et ce qu’on vous cache”